第2章:なぜ今「圧縮技術」が必要なのか?狂乱のメモリ市場

TurboQuantのようなメモリ節約技術が渇望される背景には、2026年現在の異常なメモリ市場環境があります。

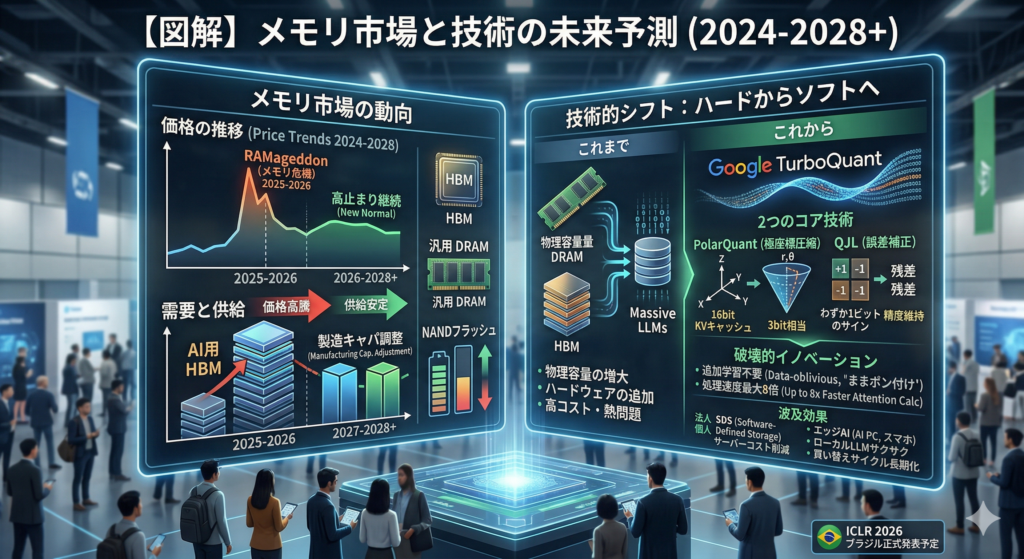

「RAMageddon」と価格のハイパーインフレ 2025年第4四半期から2026年第1四半期にかけて、DRAM、NANDフラッシュ、HBM(広帯域メモリ)の価格は過去最高値を更新し、一部のコンベンショナル(汎用)DRAMでは前四半期比で90%〜95%もの急騰が確認されています 。

供給不足の真因:キャパシティの「クラウドアウト(押し出し)」 この異常事態の根本原因は、単なる需要増ではなく、製造キャパシティの戦略的な再配分にあります 。AIサーバーに不可欠なHBMは、標準的なDRAMと同じ容量を製造するために約3倍のウェーハ面積を消費します 。メモリメーカー各社は、利益率が高くAI需要に直結するHBMの生産を最優先にしているため、スマートフォンやPC向けの標準DRAMの生産枠が大幅に削減されました 。

この結果、汎用DRAMが極端な品薄状態に陥り、2025年末には史上初めて「汎用DRAMの利益率がプレミアム製品であるHBMを上回る」という異常な逆転現象すら発生しています 。

第3章:周辺技術の攻防とサプライチェーンのリスク

NANDフラッシュ市場や次世代メモリの開発現場でも、深刻なボトルネックと覇権争いが繰り広げられています。

- NANDフラッシュの完売と製造限界: 主要メーカーのKioxiaは「2026年分のNANDフラッシュおよびSSDの生産枠はすでに完全に完売状態にある」と宣言しました 。3D NAND技術は、数百層にも及ぶ深い穴を貫通させるエッチング加工が物理的な壁に直面しており、歩留まりの低下が供給不足に拍車をかけています 。

- 次世代HBM4のパッケージング戦争: 16層に積層される次世代規格「HBM4」では、熱散逸の問題が最大の障壁です 。液状エポキシ注入による「MR-MUF」方式を採用し熱を効率よく逃がすSK hynixが優位に立つ一方で、非導電性フィルムを使用する「TC-NCF」方式を採用したSamsungは、フィルムが断熱材となってしまい歩留まり難に苦しみ、量産を延期する事態に追い込まれています 。

- マクロ経済と地政学リスク: 中東情勢の緊迫化による海上交通の麻痺は、エネルギー価格を高騰させています 。また、半導体製造に不可欠な特殊ガス(ヘリウムなど)の供給不安も重なり、製造コストを直接的に押し上げています 。

第4章:個人と法人の「メモリ経済」相場と未来予測

この深刻なメモリ危機は、エンドユーザーのエコシステムにも多大な影響を及ぼしています 。

【法人市場】データセンターのアーキテクチャ変革

法人のデータセンター投資において、ハードウェアの調達コストは青天井となっています。大容量のエンタープライズSSD(eSSD)やサーバー向けDRAMの需要が爆発する中 、システム設計者は「少ない物理メモリでより多くの処理を行う」手法の模索を余儀なくされています 。 今後は、物理的にメモリを増設するアプローチから、データ圧縮や効率的なエンコーディング技術を備えた「ソフトウェア・デファインド・ストレージ(SDS)」への移行が加速すると予測されます 。GoogleのTurboQuantも、まさにこの「メモリを極限まで効率的に使い切る」という時代の要請に応えるものです。

【個人市場】コンシューマー機器への壊滅的打撃とエッジAI

メモリ価格の暴騰により、PCやスマートフォンのBOM(部品表)コストに占めるメモリの割合が急増しています 。デバイスメーカーは利益率の低いモデルの生産を維持できず、「500ドル未満のエントリーレベルPCセグメントは2028年までに市場から姿を消す」と予測されています 。これにより、消費者の買い替えサイクルは大幅に長期化する見通しです 。 一方で、TurboQuantのような技術がオープンソース化され普及すれば、ローカル環境でLLMを動かす「エッジAI(AI PC・AIスマホ)」において、少ない物理メモリでも高度な処理が可能になる道が開かれます。ハードウェアの高騰によるダメージを、ソフトウェアの革新がどこまで吸収できるかが今後の焦点となります。

おわりに:新常態(ニューノーマル)としての「高価なメモリ」時代

現在の供給逼迫と価格の高止まりは、メーカー側の過去の暴落を恐れた強力な「資本規律」により、少なくとも2027年後半から2028年にかけて継続すると見られています 。

もはやメモリは、安価にいくらでも調達できるコモディティではなく、確保そのものが事業継続を左右する「戦略的不可欠資産」へと変貌を遂げました 。この新しい現実を生き抜くためには、安定した供給パートナーシップの構築に加え、Googleの「TurboQuant」に代表されるような、限られたリソースを数学的・アルゴリズム的な力で何倍にも引き上げるソフトウェア技術の積極的な導入が不可欠となるでしょう 。